Авторизация

Сброс пароля

Как увеличить трафик на 60% и при чем здесь Indexing API. Кейс «Амурфармации»

Страница кейса/результат: https://blog.kinetica.su/keys_indexing_api_apteka/

1. Вводная задача от заказчика, проблематика, цели

«Амурфармация» — крупная аптечная сеть с Дальнего Востока. Большой ассортимент, тысячи товарных страниц, конкуренция с маркетплейсами и агрегаторами. Всё это требует, чтобы сайт работал быстро — и в поиске в том числе.

Когда мы зашли в проект, картина была такая: сайт содержал около 80 тысяч страниц, но поисковые боты сканировали его со скоростью ~50 запросов в сутки. Это катастрофически мало. Причина — редизайн, после которого часть страниц несколько месяцев оставалась пустой. Google «запомнил» этот опыт и срезал краулинговый бюджет до минимума.

Последствия прямые: новые товары не появляются в выдаче неделями, правки не индексируются, органика стагнирует. На рынке, где конкуренты — Wildberries, Ozon и аптечные агрегаторы — обновляют выдачу ежедневно, это медленная смерть позиций.

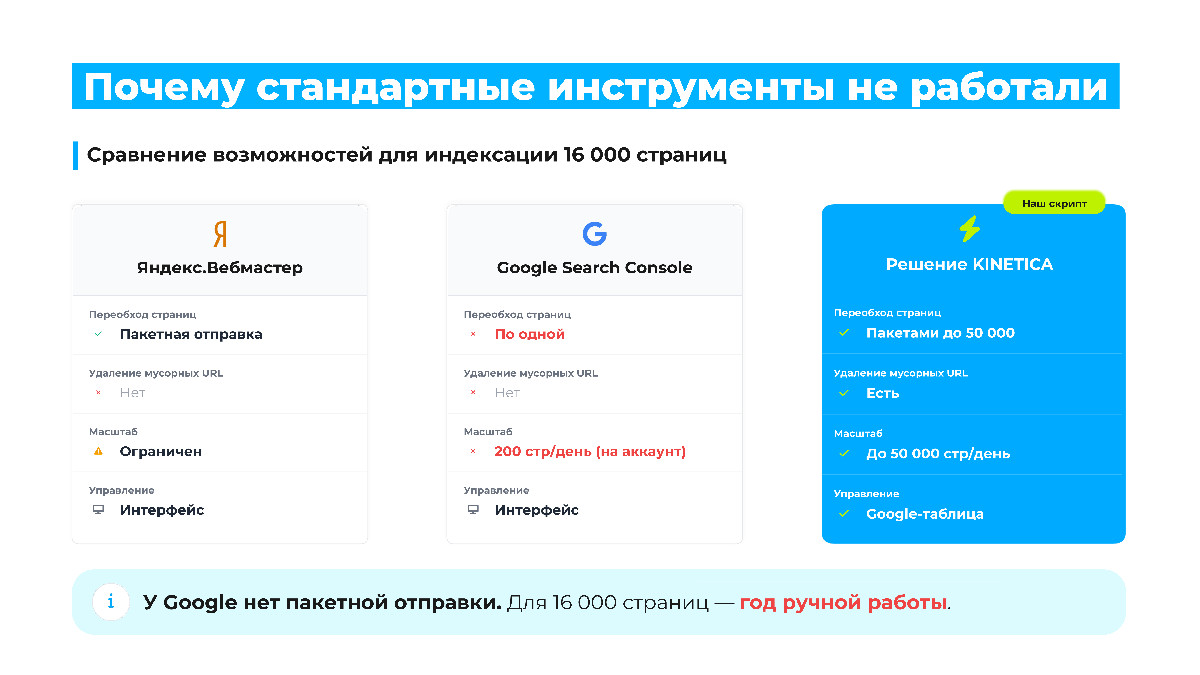

Стандартный инструмент Google Search Console позволяет отправить страницу на переобход только по одной. При 80 тысячах страниц это не решение. Нужен был другой подход.

Исходные данные:

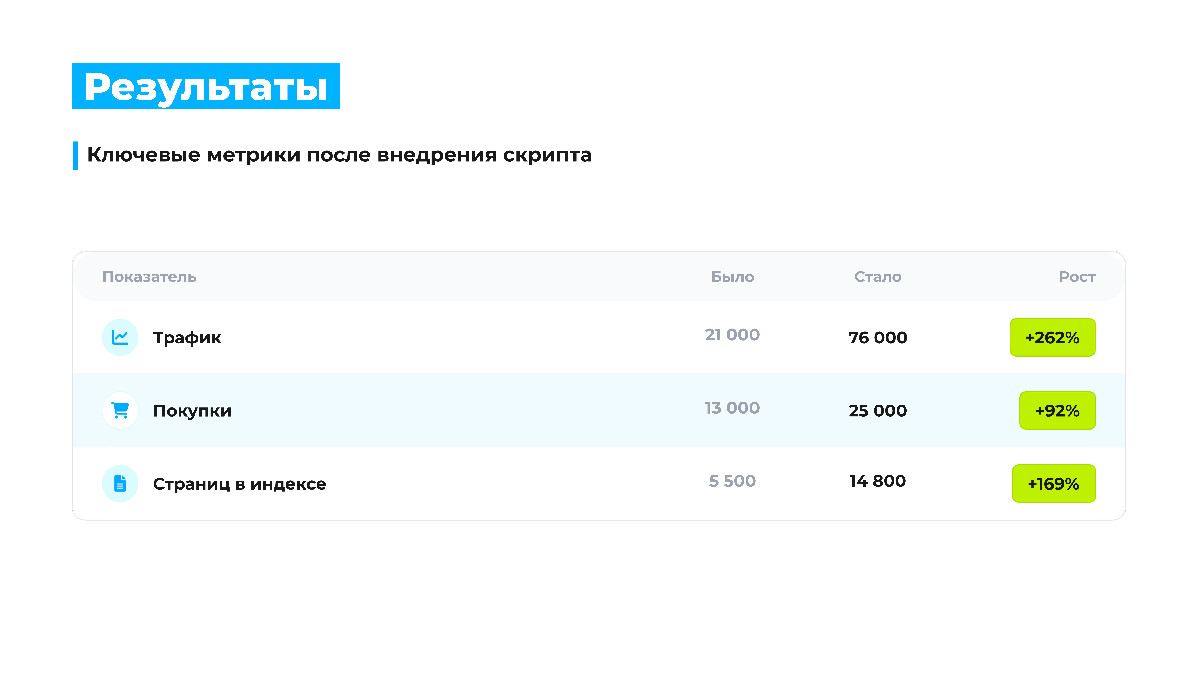

—Органический трафик: 21 000 визитов/мес (падение с ~60 000)

—Страниц в индексе Google: 5 500 из 16 000 существующих

—Краулинговый бюджет: 64 страницы в день

—Расчётное время полного обхода сайта: около 250 дней

2. Описание реализации кейса и творческого пути по поиску оптимального решения

Мы сфокусировались не на симптомах, а на первопричине: низком краулинговом бюджете.

Этап 1. Диагностика. Выявили корень проблемы: не контент, не ссылки — краулинговый бюджет. Пять месяцев пустых страниц после редизайна убедили Google, что сайт не стоит частого обхода. Стандартные SEO-правки в таком режиме просто не успевали попасть в индекс.

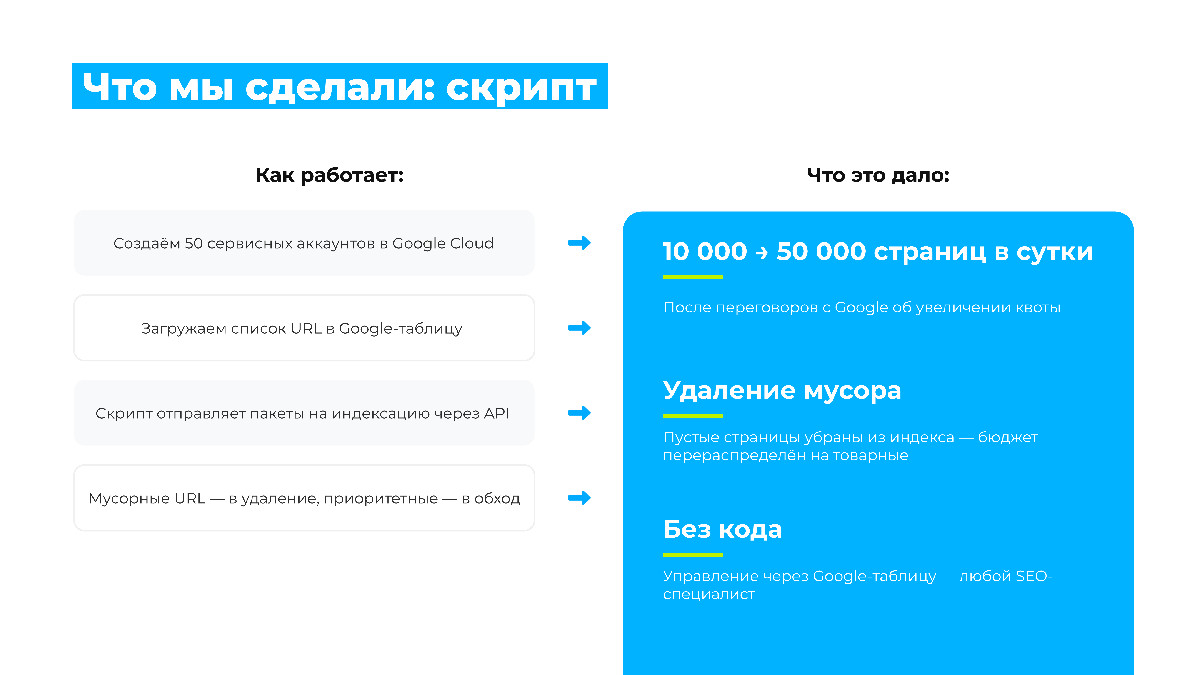

Этап 2. Собственный скрипт на базе Google Indexing API. Мы разработали скрипт, который отправляет URL группами на принудительную индексацию — вместо ручной подачи по одной странице. Один аккаунт даёт лимит 200 страниц в день. Мы подключили 50 аккаунтов — это 10 000 страниц в сутки. Дополнительно договорились с Google об увеличении квоты до 50 000 страниц.

Скрипт умеет не только добавлять страницы в индекс, но и удалять «мусорные» URL — пустые и нерелевантные страницы, которые съедали краулинговый бюджет. Управление вынесено в Google-таблицу: SEO-специалист загружает список и запускает задачу без погружения в код.

Этап 3. Комплексная техническая оптимизация. Параллельно устранили системные проблемы: настроили 301-редиректы, починили robots.txt, добавили канонические теги, проработали метаданные и сниппеты. Технические правки теперь доходили до поисковика — потому что инфраструктура индексации наконец работала.

3. Результаты сотрудничества

Через несколько недель после запуска скрипта сайт начал занимать лидирующие позиции по ключевым кластерам. По кластеру «антикоагулянты» зафиксирован резкий рост показов в Google.

Главный результат: органический трафик вырос на 62% — с 59 000 визитов в июне до 95 500 в декабре.

Что изменилось в индексации:

— скорость появления новых страниц в выдаче: с нескольких недель до 24 часов;

— объём принудительно проиндексированных страниц: до 50 000 в сутки вместо 50;

— «мусорные» страницы удалены

— краулинговый бюджет перераспределён на приоритетные URL.

Масштабируемость решения: скрипт применили на других проектах: интернет-магазин сварочного оборудования — индексируемые страницы выросли с 340 до 640 за один день; информационный портал — удалено 30 000 нерелевантных страниц, позиции выросли.

4. Заключение

Проблема краулингового бюджета — одна из самых недооцененных в SEO. Агентства чинят контент, наращивают ссылки, оптимизируют скорость — но если Google не сканирует сайт достаточно часто, все эти правки просто не попадают в индекс вовремя.

Мы решили это не обходным путём, а в лоб: разработали собственный инструмент, который снимает ограничение на уровне инфраструктуры. 50 000 страниц в сутки вместо 50.

Кейс значим для рынка: многостраничные сайты — интернет-аптеки, магазины, каталоги — сталкиваются с этой проблемой повсеместно, особенно после редизайнов. Скрипт уже работает на десятках проектов агентства. Это не разовое решение под одного клиента — это инструмент, который закрывает системный пробел в работе с Google.